Qu'est-ce que l'orchestration de conteneurs ?

L'orchestration de conteneurs est une technologie qui automatise le déploiement, la gestion et l'échelle des applications conteneurisées. Il simplifie les tâches complexes de gestion d'un grand nombre de conteneurs. Les orchestrateurs de conteneurs, tels que Kubernetes, garantissent que ces conteneurs interagissent efficacement entre différents serveurs et environnements. Les orchestrateurs fournissent un cadre pour gérer les cycles de vie des conteneurs, faciliter la découverte des services et maintenir une haute disponibilité. Pour les architectures de microservices, où les applications cloud-native sont constituées de nombreux composants interdépendants, ce Framework est fondateur.

En tirant parti de l'orchestration de conteneurs, les équipes DevOps peuvent rationaliser l'approvisionnement, l'allocation des ressources et l'échelle, ce qui leur permet d'exploiter pleinement le potentiel de la conteneurisation et de l'aligner sur leurs objectifs commerciaux.

L'orchestration de conteneurs expliquée

L'orchestration de conteneurs automatise le déploiement, la gestion et l'échelle des applications conteneurisées. Les entreprises s'appuient sur des orchestrateurs pour contrôler et coordonner un grand nombre de conteneurs, en veillant à ce qu'ils interagissent efficacement sur différents serveurs.

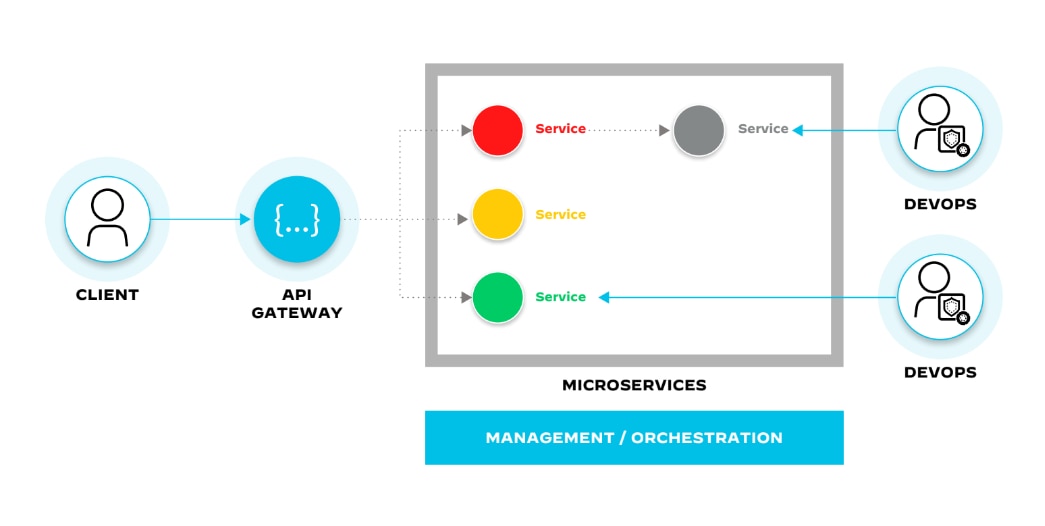

Figure 1 : Couche d'orchestration déployant de nouvelles versions de microservices, mettant à l'échelle les microservices pour répondre à la demande, et surveillant les microservices pour la performance et la santé.

Les orchestrateurs comme Kubernetes gèrent les cycles de vie, facilitent la découverte des services et maintiennent la haute disponibilité. Ils permettent aux conteneurs de fonctionner de concert, ce qui est essentiel pour les architectures microservices où les applications Cloud Native sont constituées de nombreux composants interdépendants.

Le marché de l'orchestration de conteneurs suit en effet le rythme de l'adoption des architectures microservices, des applications Cloud Native et de la containerization. Calculée à 745,72 millions de dollars US en 2022 - en hausse de 26 % en cinq ans - la taille du marché continue de grimper et devrait atteindre 1084,79 milliards de dollars US en 2029.

Outils d'orchestration

Les outils d'orchestration fournissent un cadre pour l'automatisation des charges de travail des conteneurs, permettant aux équipes DevOps de gérer les cycles de vie de leurs conteneurs. Ces systèmes, ou moteurs d'orchestration, facilitent les capacités avancées de mise en réseau, rationalisant l'approvisionnement des conteneurs et des microservices tout en ajustant les ressources à la demande. Avec les orchestrateurs, les équipes DevOps peuvent exploiter tout le potentiel de la conteneurisation, en l'alignant sur leurs objectifs commerciaux.

Moteurs d'orchestration de conteneurs populaires

- Kubernetes® (K8s)

- Rancher

- SUSE Rancher

- Services Amazon Elastic Kubernetes (EKS)

- Services Azure Kubernetes (AKS)

- Google Kubernetes Engine (GKE) / Anthos

- Red Hat OpenShift Container Platform (OCP)

- Mésos

- Plate-forme de conteneurs Cisco (CCP)

- Oracle Container Engine for Kubernetes (OCE)

- Ericsson Container Cloud (ECC)

- Docker Swarm

- HashiCorp Nomad

L'avantage des moteurs d'orchestration vient du modèle déclaratif qu'ils emploient généralement, qui combine efficacement les avantages de l' infrastructure en tant que service (IaaS) et de la plateforme en tant que service (PaaS).

- L'IaaS offre le contrôle granulaire et l'automatisation qui permettent aux développeurs de gérer l'infrastructure sous-jacente, comme les serveurs, le stockage et le réseau. Les développeurs ont ainsi la possibilité de personnaliser leurs déploiements pour répondre à des besoins spécifiques.

- Le PaaS offre un niveau d'abstraction plus élevé qui permet aux développeurs de se concentrer sur leurs applications sans avoir à se préoccuper de l'infrastructure sous-jacente. Le PaaS permet aux ingénieurs de déployer et de gérer plus facilement leurs applications, mais il leur offre également moins de contrôle sur l'infrastructure.

Tirant le meilleur des deux mondes, les orchestrateurs offrent aux développeurs puissance et flexibilité, ainsi qu'une expérience opérationnelle cohérente dans tous les environnements, des machines physiques et des centres de données sur place aux déploiements virtuels et aux systèmes basés sur le cloud.

Les fonctions essentielles des principaux moteurs d'orchestration comprennent la planification, la gestion des ressources, la découverte des services, les contrôles de santé, la mise à l'échelle automatique et la gestion des mises à jour et des mises à niveau.

Composants clés des orchestrateurs

La terminologie des composants d'orchestration de conteneurs varie d'un outil à l'autre sur le marché. Les concepts et fonctionnalités sous-jacents restent cependant relativement cohérents. Le tableau 3 donne un aperçu comparatif des principaux composants et de la terminologie correspondante pour les orchestrateurs de conteneurs les plus répandus. Pour nos besoins, nous utiliserons les termes de Kubernetes afin de présenter les mécanismes d'orchestration.

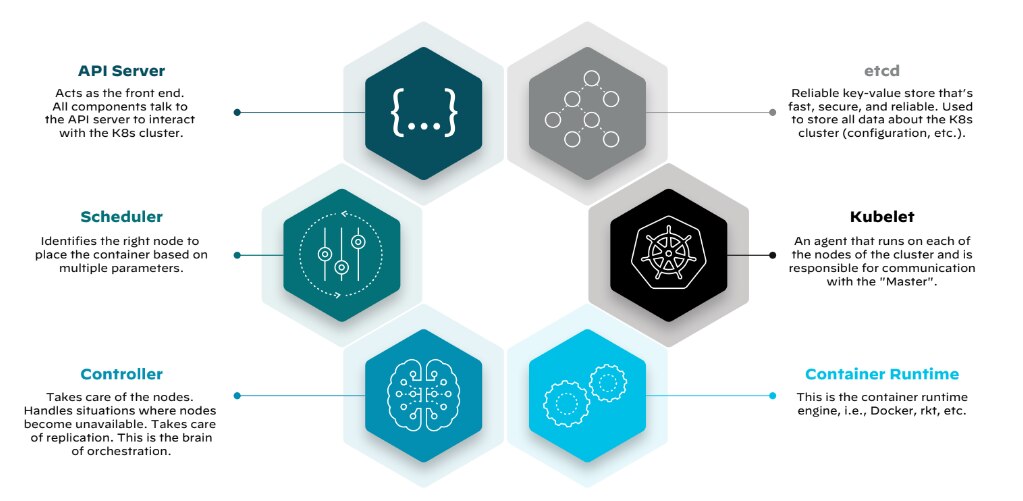

Figure 2 : Vue d'ensemble du composant d'orchestration de conteneurs

Les moteurs d'orchestration comme Kubernetes sont complexes, constitués de plusieurs composants technologiques clés qui fonctionnent à l'unisson pour gérer le cycle de vie des conteneurs. En comprenant les composants clés, vous comprendrez comment utiliser au mieux les technologies de conteneurisation.

Le plan de contrôle

Au cœur de Kubernetes se trouve son plan de contrôle, le centre de commande pour la planification et la gestion du cycle de vie des applications. Le plan de contrôle expose l'API Kubernetes, orchestre les déploiements et dirige la communication dans l'ensemble du système. Il surveille également la santé des conteneurs et gère le cluster, en veillant à ce que les images du conteneur soient facilement disponibles à partir d'un registre pour le déploiement.

Le plan de contrôle de Kubernetes comprend plusieurs composants - le etcd, le serveur API, le planificateur et le contrôleur-gestionnaire.

Etcd

Le datastore etcd, développé par CoreOS et racheté plus tard par Red Hat, est un magasin clé-valeur distribué qui contient les données de configuration du cluster. Il informe les actions de l'orchestrateur pour maintenir l'état souhaité de l'application, tel que défini par une politique déclarative. Cette politique décrit l'environnement optimal pour une application, en guidant l'orchestrateur dans la gestion de propriétés telles que le nombre d'instances, les besoins de stockage et l'allocation des ressources.

Serveur API

Le serveur API de Kubernetes joue un rôle central, en exposant les capacités du cluster via une interface RESTful. Il traite les demandes, les valide et met à jour l'état de la grappe en fonction des instructions reçues. Ce mécanisme permet une configuration et une gestion dynamiques des charges de travail et des ressources.

Planificateur

Le planificateur de Kubernetes affecte les charges de travail aux nœuds de travail en fonction de la disponibilité des ressources et d'autres contraintes, telles que la qualité de service et les règles d'affinité. L'ordonnanceur veille à ce que la répartition des charges de travail reste optimisée en fonction de l'état actuel de la grappe et de la configuration des ressources.

Contrôleur-gestionnaire

Le gestionnaire de contrôleur maintient l'état souhaité des applications. Il fonctionne grâce à des contrôleurs, des boucles de contrôle qui surveillent l'état partagé de la grappe et procèdent à des ajustements pour aligner l'état actuel sur l'état souhaité. Ces contrôleurs assurent la stabilité des nœuds et des pods, en réagissant aux changements dans l'état de santé du cluster afin de maintenir la cohérence opérationnelle.

| Orchestrateur de conteneurs | Composants du plan de contrôle | Composants du nœud de travail | Unité de déploiement | Service |

|---|---|---|---|---|

| Kubernetes | Serveur API, planificateur, gestionnaire de contrôleurs, etcd | kubelet | Cosse | Service |

| Docker Swarm | Gestionnaire | Travailleur | Service | Pile |

| Nomade | Serveur | Agent | Emploi | Allocation |

| Mésos | Maître | Agent | Tâche | Emploi |

| OpenShift | Console, Controller Manager, etcd | Nœud | Cosse | Service |

| Amazon Elastic Container Service (ECS) | Contrôleur de cluster | Instances EC2 | Tâche | Service |

| Moteur Google Kubernetes (GKE) | Plan de contrôle | Nœuds | Cosse | Service |

| Service Azure Kubernetes (AKS) | Plan de contrôle | Nœuds | Cosse | Service |

Tableau 1 : Composants communs à plusieurs moteurs d'orchestration.

Orchestration et infrastructure immuable

Contrairement aux serveurs traditionnels et aux machines virtuelles, le paradigme immuable que les conteneurs et leur infrastructure habitent rend les modifications post-déploiement inexistantes. Au lieu de cela, les mises à jour ou les correctifs sont appliqués en déployant de nouveaux conteneurs ou serveurs à partir d'une image commune comportant les modifications nécessaires.

La programmabilité inhérente à l'infrastructure immuable permet l'automatisation. L'infrastructure en tant que code (IaC) est une caractéristique de l'infrastructure moderne, qui permet aux applications d'approvisionner, de configurer et de gérer l'infrastructure requise de manière programmatique. La puissance combinée de l'orchestration de conteneurs, de l'infrastructure immuable et de l'automatisation pilotée par l'IaC offre une flexibilité et une évolutivité inégalées.

Orchestration de conteneurs et pipeline

Propulsée par les moteurs jumeaux de la conteneurisation et de DevOps, l'orchestration de conteneurs réunit vitesse et évolutivité pour sous-tendre le pipe de productiondynamique et exigeant d'aujourd'hui.

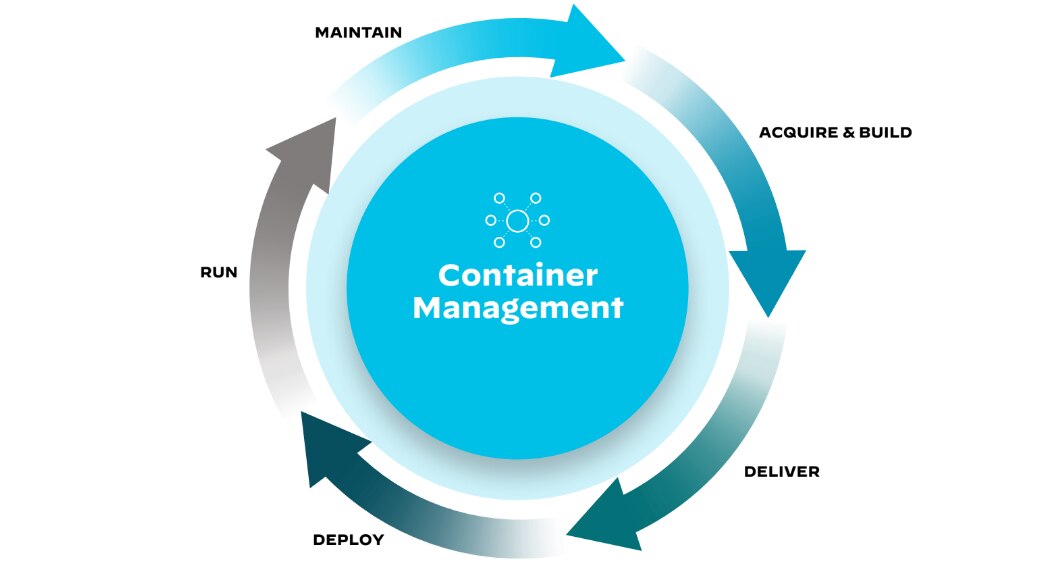

Figure 3 : Pipelines CI/CD cycle de vie de développement des applications.

Phase d'acquisition et de construction du pipeline

Lors de l'étape d'acquisition et de construction, les développeurs extraient le code des référentiels de contrôle de version, lançant ainsi le processus de construction. Les outils automatisés compilent le code source en artefacts binaires prêts à être déployés à l'aide d'un outil comme Docker ou BuildKit. Une fois l'image du conteneur construite, elle est stockée dans un registre tel que Docker Hub ou Google Artifact Registry.

La phase d'acquisition et de construction favorise une construction cohérente de l'application, avec des scripts gérant les dépendances et exécutant des tests préliminaires. Le résultat est une construction fiable qui, lorsqu'elle est intégrée à la branche principale, déclenche d'autres processus automatisés.

Phase d'exécution

À la fin de la phase de construction, le pipeline exécute le code dans un environnement contrôlé. L'exécution de l'image du conteneur dans un environnement de mise à disposition peut se faire à l'aide d'un outil d'orchestration de conteneurs tel que Kubernetes. Cette étape cruciale implique que l'équipe effectue une série de tests automatisés pour valider la fonctionnalité de l'application. Les développeurs recherchent activement les bogues et les corrigent, ce qui garantit la progression d'un code de haute qualité dans le pipeline.

Phase de livraison

Au stade de la livraison du pipeline CI/CD, les équipes automatisent le parcours du nouveau code depuis le référentiel jusqu'à l'état de préparation à la production. Chaque livraison déclenche une séquence de tests automatisés rigoureux et de contrôles de qualité, garantissant que seul le code bien validé atteint l'environnement de mise à disposition. Le logiciel est alors soumis à des validations supplémentaires, souvent en contact avec le client. Le processus décrit la promotion de la construction à travers les environnements, chacun servant de terrain d'essai pour la stabilité et la performance. L'engagement de l'équipe dans la phase de livraison garantit que le logiciel incarne le meilleur des efforts de développement actuels.

Phase de déploiement

Lors de la phase de déploiement, l'application atteint son moment charnière lorsque les équipes la déploient dans l'environnement de production. Les outils d'orchestration de conteneurs, tels que Kubernetes, prennent le contrôle, mettent l'application à l'échelle et la mettent à jour avec un temps d'arrêt minimal. Les équipes disposent de mécanismes de retour en arrière qui leur permettent de revenir aux versions précédentes en cas de problème. À ce stade, l'application devient opérationnelle, sert les utilisateurs prévus et remplit son rôle dans l'écosystème numérique.

Maintenir le stade

Après le déploiement, l'équipe passe à la maintenance active de l'application. Ils utilisent une solution d'exécution pour contrôler constamment les performances, enregistrer les erreurs et recueillir les commentaires des utilisateurs, autant d'éléments qui déterminent les améliorations futures, ainsi que la sécurité des conteneurs.

Lorsque les développeurs affinent l'application, appliquent des correctifs de sécurité et déploient de nouvelles fonctionnalités, la phase de maintenance souligne la nature itérative du développement d'applications modernes. Invariablement, le produit continue d'évoluer pour répondre aux demandes des utilisateurs et intégrer les dernières avancées technologiques.

Avantages de l'orchestration de conteneurs

L'orchestration de conteneurs offre une série d'avantages qui s'alignent sur les objectifs de DevOps, améliorant au final l'efficacité opérationnelle et réduisant les frais généraux dans les environnements cloud.

Améliore l'évolutivité

Les plateformes d'orchestration de conteneurs permettent aux entreprises de faire évoluer les applications conteneurisées en fonction de la fluctuation de la demande - sans intervention humaine ni tentative de prédire la charge des applications. Les capacités de bin packaging et d'autoscaling de l'orchestrateur, associées à l'infrastructure du cloud public en tant que code, allouent dynamiquement les ressources, garantissant ainsi des performances optimales lors des pics de charge.

Facilite la résilience

En répartissant les instances de conteneurs sur plusieurs hôtes, les outils d'orchestration renforcent la résilience des applications. Ils détectent les défaillances et réinitialisent automatiquement les conteneurs, ce qui minimise les temps d'arrêt et maintient la continuité du service.

Favorise l'efficacité

Les moteurs d'orchestration ajustent les ressources exactement à ce qu'une application exige dans divers scénarios d'utilisation, évitant ainsi un surprovisionnement rampant ou obligeant les organisations à concevoir et à planifier une utilisation élevée de l'eau. Cette efficacité permet de réduire les coûts d'infrastructure et de maximiser le retour sur investissement.

Simplification de la gestion

Les orchestrateurs de conteneurs fournissent une interface unifiée pour gérer les grappes de conteneurs, en faisant abstraction des tâches complexes et en réduisant la charge opérationnelle. Les équipes peuvent déployer des mises à jour, surveiller l'état de santé et appliquer des politiques avec une intervention manuelle minimale.

Amélioration de la sécurité

L'orchestration des conteneurs renforce la sécurité en automatisant le déploiement des correctifs et des mises à jour de sécurité. Il applique des politiques de sécurité cohérentes à l'ensemble du parc de conteneurs, réduisant ainsi le risque de vulnérabilités.

Permet la portabilité

L'orchestration garantit que les applications conteneurisées restent agnostiques par rapport à l'infrastructure sous-jacente, ce qui facilite la portabilité dans différents environnements cloud et centres de données sur place.

Accélère les cycles de déploiement

En automatisant les processus de déploiement, les outils d'orchestration raccourcissent le délai entre le développement et la production, ce qui permet une itération rapide et une mise sur le marché plus rapide des nouvelles fonctionnalités.

Prend en charge les pratiques DevOps

S'intégrant aux pipelines CI/CD et améliorant l'agilité du développement logiciel, l'orchestration de conteneurs favorise la collaboration entre les équipes de développement et d'exploitation. Des capacités telles que la surveillance de la santé et l'autoréparation permettent aux équipes d'effectuer moins de support système et de dépannage, optimisant ainsi la productivité DevOps.

L'écosystème des conteneurs

Tout simplement, l'écosystème des conteneurs représente un changement important dans le développement et le déploiement des applications. Englobant toute une série de composants - des moteurs d'exécution aux plateformes d'orchestration, en passant par les registres et les outils de sécurité - il offre aux entreprises l'efficacité indispensable qu'exige le paysage numérique actuel, qui évolue très rapidement.

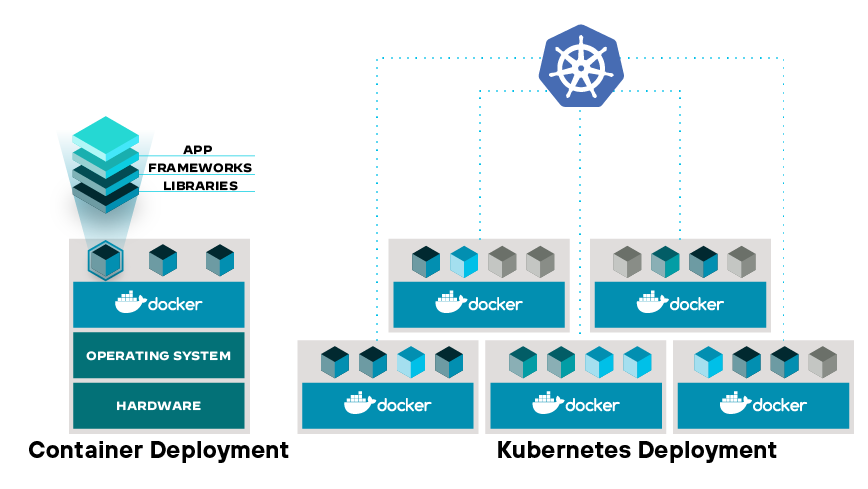

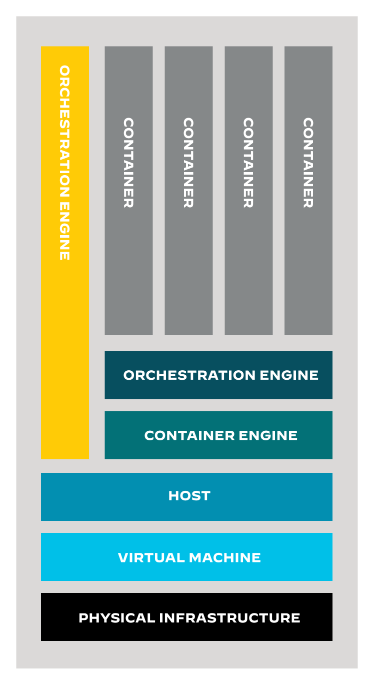

Bien entendu, au cœur de l'écosystème se trouve la synergie entre le moteur de conteneurs et le moteur d'orchestration. Ensemble, ces technologies guident les applications conteneurisées à travers les étapes complexes de leur cycle de vie.

Le moteur de conteneur crée et progiciel des conteneurs individuels, tandis que le moteur d'orchestrateur gère et orchestre plusieurs conteneurs sur une infrastructure distribuée.

Pendant le développement, le moteur de conteneurs facilite le prototypage et les tests rapides, ce qui permet aux développeurs de procéder à des itérations rapides et efficaces. Au fur et à mesure que l'application mûrit, l'orchestrateur la fait passer en production, fournissant ainsi une base robuste et évolutive pour gérer les charges de travail du monde réel.

Figure 4 : Docker et Kubernetes représentant la dynamique des moteurs de conteneurs et d'orchestration.

Implications stratégiques pour les chefs d'entreprise

Agilité et rapidité dans le déploiement des logiciels

L'écosystème des conteneurs accélère le déploiement des applications. En encapsulant les applications dans des conteneurs, les organisations peuvent passer rapidement du développement à la production, quel que soit l'environnement sous-jacent. Cette agilité est cruciale pour les organisations qui doivent s'adapter rapidement aux évolutions du marché ou aux demandes des utilisateurs.

Efficacité accrue et optimisation des ressources

Offrant une alternative aux machines virtuelles traditionnelles, les conteneurs partagent le noyau du système d'exploitation sous-jacent et consomment moins de ressources. Cette efficacité se traduit par une réduction des coûts opérationnels et une meilleure utilisation des ressources informatiques, un avantage clé pour les entreprises qui gèrent des applications à grande échelle.

Évolutivité et flexibilité

Vitaux pour les entreprises numériques confrontées à une demande fluctuante, les orchestrateurs de l'écosystème des conteneurs permettent aux entreprises de faire évoluer leurs applications sans compromettre les performances. L'écosystème des conteneurs dans son ensemble affine les capacités précédentes en matière d'échelle et de disponibilité des ressources.

Cohérence et portabilité dans tous les environnements

L'écosystème des conteneurs garantit la cohérence et la portabilité. Les applications progicielles dans des conteneurs peuvent s'exécuter de manière uniforme et fiable dans différents environnements computing, des centres de données sur place aux clouds publics.

Figure 5 : Anatomie d'un environnement de conteneurs hébergés

Se préparer à un avenir axé sur les conteneurs

L'avenir laisse entrevoir un monde numérique où la plupart des applications, si ce n'est toutes, s'exécutent sur des conteneurs. Pour les dirigeants, comprendre la synergie de l'écosystème des conteneurs constitue un avantage stratégique. Disposer d'un point de vue éclairé peut vous permettre d'anticiper et de répondre efficacement aux exigences en constante évolution du développement de logiciels modernes - et ce, avec un retour sur investissement optimal.